© Tsp

Verräterische Mimik: Sollen Maschinen unsere Gefühle lesen?

Softwareprogramme können Mimik oder die Stimme auswerten und damit unsere wahren Gefühle errechnen. Doch wenn wir unsere Emotionen vor Maschinen nicht mehr verbergen können, ist ein Missbrauch der Technik wahrscheinlich.

Es kann ein winziges Naserümpfen sein, ein kaum merkliches Hochziehen der Augenbrauen oder leicht herabhängende Mundwinkel: Dr. Cal Lightman entgeht nichts. Wenn der Täuschungsexperte aus der amerikanischen TV-Serie „Lie to me“ für Polizei oder FBI Verhöre durchführt, dann provoziert er die Verdächtigen – oft so weit, bis sie für den Bruchteil einer Sekunde ihre wahren Gefühle preisgeben. Ihr Gesicht verrät sie.

Das funktioniert nur, weil die mimische Muskulatur bis zu einer halben Sekunde schneller ist als der Verstand und direkt mit dem Emotionszentrum im Gehirn verknüpft ist. Gefühle lassen sich an diesen kurzen, unfreiwilligen Mikroexpressionen also unmittelbar ablesen – wenn man weiß, was einzelne Gesichtsausdrücke bedeuten. In den 70er Jahren hat der amerikanische Psychologe Paul Ekman, der als Vorbild für die Serienfigur Lightman diente, deshalb das „Facial Action Coding System“ (FACS) entwickelt. Darin ist jede mögliche Muskelbewegung im Gesicht katalogisiert, und deren Kombinationen sind Emotionen wie Wut, Ekel, Verachtung oder Überraschung zugeordnet.

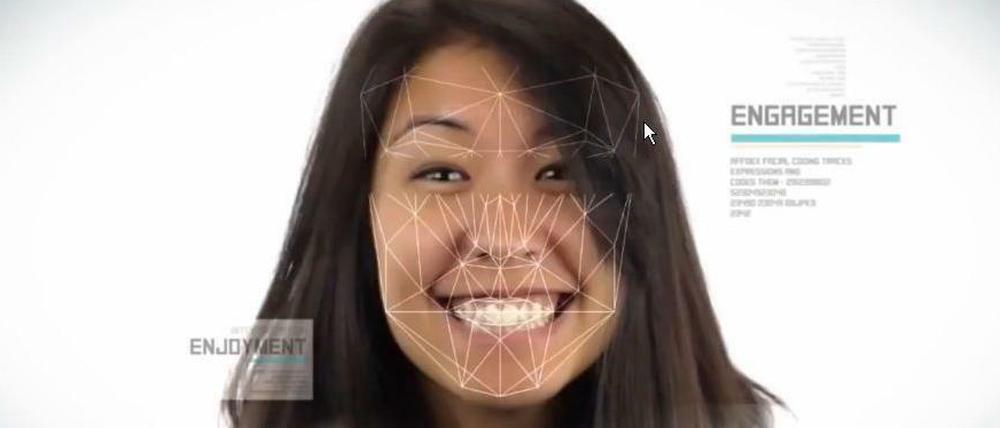

Das Programm erkennt muskuläre Veränderungen im Gesicht

Seit Jahrzehnten wird der Katalog weltweit von Psychologen zur Einordnung von Gesichtsausdrücken verwendet. Doch jetzt hat eine Reihe von jungen Unternehmen Ekmans Forschung für sich entdeckt und eine Software entwickelt, die in Echtzeit unsere wahren Gefühle berechnen soll. US-Firmen wie Affectiva, Eyeris und Emotient zählen dazu. Auch das in Deutschland und der Schweiz ansässige Link Institut verwendet eine solche Software.

Das Programm erkennt muskuläre Veränderungen im Gesicht und berechnet aus dem Zusammenspiel einzelner Bewegungen die Emotionen eines Menschen. So würde beispielsweise das Heben der Mundwinkel gemeinsam mit dem Zusammenziehen des Ringmuskels um die Augen auf Freude schließen lassen. Die mimischen Veränderungen werden mit einer Webcam aufgezeichnet und elektronisch ausgewertet.

Dabei verbessert sich die Software stetig, denn je mehr Gesichter sie auswertet, desto größer ist der Datensatz, mit dem sie neue Aufnahmen vergleicht. Affectivas Programm „Affdex“ hat beispielsweise bereits 2,7 Millionen Gesichter in mehr als 75 Ländern ausgewertet. „Das Gute ist, dass die Basisemotionen im Gesicht anders als Gesten über alle Kulturen hinweg gleich sind“, sagt Aleksa Möntmann, die für das Link Institut arbeitet. Der von dem Unternehmen angebotene Service „Emoticam“ wird vor allem eingesetzt, um herauszufinden, wie Werbung auf Zuschauer wirkt. Dabei werden die Probanden am eigenen Computer mit ihrer Webcam gefilmt, während sie einen Spot schauen. So will man prüfen, ob dieser die gewünschte Wirkung bei ihnen erreicht. Die Teilnahme ist freiwillig, es gibt eine Aufwandsentschädigung für die Probanden. „Von dieser Technik geht eine hohe Faszination aus, die Nachfragen von Unternehmen werden häufiger“, sagt Möntmann.

Auch die Stimme lässt Rückschlüsse auf Gefühle zu

Kein Wunder: Welche Kaufentscheidungen wir treffen, hängt stark davon ab, welche Gefühle wir einem bestimmten Produkt entgegenbringen. Für die Unternehmen ist es deshalb Geld wert, zu wissen, wie sich ihre potenziellen Kunden beim Anschauen eines Werbeclips fühlen – und das am besten schon, bevor dieser im Fernsehen ausgestrahlt wird. Affectiva etwa arbeitet mit großen Firmen wie Coca-Cola oder Unilever. Die Wirkung von Filmtrailern kann man via Software ebenfalls testen.

Rückschlüsse auf die menschlichen Gefühle lässt aber nicht nur das Gesicht, sondern auch die Stimme zu. Das israelische Start-up Beyond Verbal hat eine Software entwickelt, die über die Stimme das Gefühlsleben von Menschen auskundschaften will. „Das Programm wird beispielsweise in Call-Centern eingesetzt, um dem Mitarbeiter Hinweise darauf zu geben, wie sich der Kunde fühlt, aber auch wie er selbst rüberkommt“, sagt der CEO des Unternehmens, Yuval Mor. Zudem könnten Firmen mithilfe der Software herausfinden, welche Gefühle ein Kunde für ein bestimmtes Produkt hegt. „Dazu stellt man ihm Fragen – etwa: ,Wie würden Sie das Produkt einem guten Freund beschreiben?‘ “, sagt Mor.

Wofür kann die Software benutzt werden?

Beyond Verbal greift für die Auswertung auf einen wachsenden Datenpool an Stimmproben zurück – über eine Million umfasst dieser bereits. Die Proben werden über die kostenfrei downloadbare App „Moodies“ gesammelt, bei der User 20 Sekunden lang ihre Stimme aufnehmen und dann eine Einschätzung ihrer Gefühle bekommen. Das kann über Selbstkontrolle, Freundlichkeit und Traurigkeit bis hin zu Angst gehen. Stimmt diese Einschätzung mit der Selbstwahrnehmung des Nutzers überein – zu 75 Prozent sei das derzeit der Fall – und wird sie später von einem Psychologen bestätigt, ist das der „Gold Standard“, wie Mor es nennt. Er kann verwendet werden, um die Software zu verbessern. Der Nutzer hat mit der Akzeptanz der AGBs das „unwiderrufliche, unbegrenzte und weltweite“ Recht zur Modifikation und Analyse seiner Sprachaufnahmen zur internen Forschung an Beyond Verbal übertragen.

Die App soll Hilfe beim Flirten bieten

Wozu die Nutzer selbst die „Moodies“-App nutzen, weiß Yuval Mor nicht. In einem Werbespot zeigt Beyond Verbal aber zukünftige Anwendungsmöglichkeiten. Wer etwa beim Flirten die Signale des anderen nicht richtig zu deuten weiß, könnte die App mitlaufen lassen. Das Programm würde aber auch den gestressten Familienvater unterstützen, der mit den Kindern auf dem Rücksitz schimpft. Weil er offenbar abgelenkt und aufgeregt ist, könnte die App dafür sorgen, dass das Auto abbremst.

Auch die Mimikauswertung per Webcam dürfte künftig in so manchem Bereich Anwendung finden. Bei Videokonferenzen oder virtuellen Vorstellungsgesprächen würden die Gefühle des Geschäftspartners oder Bewerbers angezeigt. Affectiva hat sich bereits mit der Videokommunikationsplattform ooVoo zusammengetan, um „persönliche und geschäftliche Interaktionen zu transformieren“.

Einsatz der Software bei der Strafverfolgung

Forscher Ekman fürchtet mittlerweile, er habe mit dem Mimikkatalog ein Monster geschaffen. Dem „Wall Street Journal“ sagte er: „Ich kann nicht kontrollieren, wie er verwendet wird.“ Seine Sorge ist, dass die auf dem FACS basierende Technologie die Gefühle einzelner Personen ohne deren Einwilligung berechnet oder dass deren Emotionen falsch interpretiert werden. So könnte die Polizei die Gefühle von Menschenmassen ermitteln oder am Flughafen Menschen mit verdächtigen Emotionen herausfiltern. Das US-Unternehmen Eyeris arbeitet nach Informationen des „Wall Street Journal“ bereits mit einer staatlichen Strafverfolgungsbehörde zusammen.

Dass die Software künftig als ein verlässlicher Lügendetektor fungieren könnte, bezweifelt der Mimikexperte Dirk W. Eilert. Er hat sich für die Anwendung des FACS zertifizieren lassen und trainiert andere darin, Gesichtsausdrücke und die nur Millisekunden dauernden Mikroexpressionen zu erkennen. „Die Software verrät zwar, wie sich jemand fühlt, aber nicht, warum sich jemand so fühlt.“ So könne schnelles Blinzeln auf einen hohen Stresspegel hinweisen – dabei sei aber unklar, ob der Mensch aufgrund der Lüge oder aufgrund der Testsituation gestresst sei. Zudem kritisiert Eilert, dass die Programme häufig nicht den Kontext einer Situation, Mimikgewohnheiten des Sprechers oder das Timing eines Gesichtsausdrucks in ihre Analysen mit einbeziehen.

Was passiert, wenn die Software für Datenbrillen wie Google Glass verfügbar ist, will sich der Experte trotzdem lieber nicht vorstellen. Er fürchtet zudem, dass Menschen verlernen, anderer Gefühle zu lesen, wenn diese Aufgabe von Programmen übernommen wird. „Evolutionär heißt es: Use it or lose it. Unsere Navigationsfähigkeit haben wir dank Navi im Auto auch schon weitgehend verloren.“

- showPaywall:

- false

- isSubscriber:

- false

- isPaid:

- showPaywallPiano:

- false