© AFP

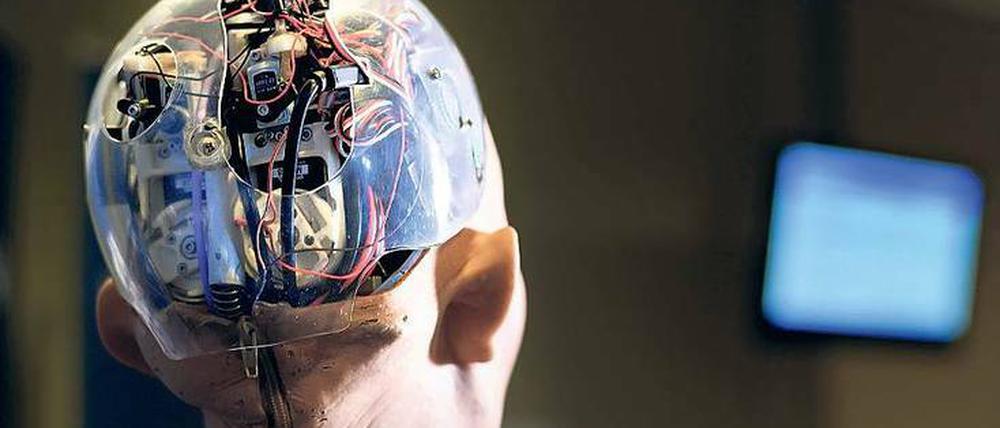

UN-Gipfel zu Künstlicher Intelligenz: Wenn Roboterautos beim Parken Krebs erforschen

Erstmals lud die UN zu einem Gipfel über Künstliche Intelligenz. Experten sehen enorme Potenziale, warnen aber auch vor Killerrobotern und anderen Gefahren.

Der Münchner Informatiker Jürgen Schmidhuber verfolgt schon seit den Achtziger Jahren eine Vision: Er will eine Künstliche Intelligenz (KI) entwickeln, die klüger ist als er selbst. Die Technologie macht derzeit große Sprünge. „Wir werden schon bald eine KI mit den Fähigkeiten einer Krähe haben“, sagt Schmidhuber. Es waren auch ehemalige Studenten von ihm, die mit der Google-Tochter Deepmind eine selbstlernende Software entwickelt haben, die im Vorjahr überraschend die besten Menschen im asiatischen Denkspiel Go besiegte. Experten hatten damit erst in einigen Jahren gerechnet. Und so werden auch Visionäre wie Schmidhuber längst nicht mehr als Spinner abgetan. „Jetzt hören mir mehr Leute zu“, sagt der Wissenschaftler.

UN will mit KI Hunger und Armut besiegen

Selbst UN-Generalsekretär António Guterres hat die Bedeutung des Themas erkannt. „Die Zeit ist für uns alle gekommen, zu prüfen, wie KI die Zukunft beeinflusst“, sagt Guterres. Daher richteten die Vereinten Nationen von Mittwoch bis Freitag erstmals einen Gipfel aus, bei dem Wissenschaftler, Politiker und Vertreter von Unternehmen und internationalen Organisationen über die Potenziale und Folgen von Künstlicher Intelligenz diskutierten. Die UN sieht in der Technologie Chancen, um die selbstgesteckten 17 Entwicklungsziele zu erreichen, darunter die Abschaffung von Armut und Hungersnöten. Auch einige Wissenschaftler und Unternehmensvertreter geben sich euphorisch. So zog Microsofts Entwicklungschef Peter Lee Parallelen zur Erfindung des Buchdrucks: „Wir könnten in einer ähnlichen Periode leben“.

Die Computer lernen gerade Sprache zu verstehen und zu Sehen. Vor allem in der Bilderkennung gibt es enorme Fortschritte, die auch in der Medizin eingesetzt werden. Lee und auch der kanadische KI-Experte Yoshua Bengio zeigten beispielsweise, wie Algorithmen eingesetzt werden, um auf Fotos und Videos Tumore zu erkennen. Die Trefferquote der Computer liegt teilweise bei mehr als 90 Prozent und damit höher als von Fachärzten. „Das ist kein Ersatz für Radiologen aber es steigert ihre Produktivität dramatisch“, sagte Lee.

Um die Maschinen zu trainieren benötigen sie möglichst viele Daten, doch zum Schutz der Privatsphäre stellen Krankenhäuser diese oft nicht zur Verfügung. Um das zu ändern, seien auch die Regierungen gefordert, sagte Bengio. Sie müssten dafür sorgen, dass Daten nicht gegen Patienten eingesetzt werden, beispielsweise durch Krankenversicherungen, die dann keinen Schutz mehr bieten.

Rechenleistung autonomer Autos zur Krebsforschung nutzen

Audi-Chef Rupert Stadler schlug vor, künftig die Rechenleistung von selbstfahrenden Autos auch für die Wissenschaft zu nutzen. „Jedes parkende Auto könnte bei der Krebsforschung mitarbeiten“, sagte Stadler. Denn so ein Fahrzeug habe eine Rechenleistung von 740 Gigaflops – vergleichbar mit einem Flugzeug einschließlich aller Back-up-Systeme.

Doch längst nicht alle Teilnehmer teilten den grenzenlosen Optimismus. Es sei eine schöne Vision, dass künftig Software und Roboter auch in Ländern die medizinische Versorgung verbessern, wo es am meisten an Ärzten mangelt, sagte die Generaldirektorin der Weltgesundheitsorganisation Margaret Chan. „Doch dort fehlt es an grundsätzlichen Dingen wie fließendem Wasser oder Elektrizität“, sagte Chan. Und ohne Strom funktioniert auch keine KI. „Und was nützt eine Krebsdiagnose, wenn es in dem Land keine Behandlungsmethoden gibt oder sich die Menschen Medizin nicht leisten können?“, gab Chan zu bedenken.

Warnung vor Robocops und Killerrobotern

Ähnlich kritisch äußerte sich Salil Shetty, Generalsekretär von Amnesty International. Schon jetzt sei die wachsende Ungleichheit das größte Problem weltweit, KI könne das noch enorm steigern. „Wenn wir wie bisher weitermachen, werden hunderte Millionen Jobs durch Automatisierung verloren gehen und mit unsicheren Stellen ersetzt“, skizzierte Shetty ein pessimistisches Szenario für das Jahr 2037. „Robocops werden auf den Straßen patrouillieren, Killerroboter Kriege austragen und so die menschlichen Kosten für die Reichen und Mächtigen reduzieren aber nicht für die Armen.“

Auch Izumi Nakamitsu, UN-Beauftragte für Abrüstungsfragen, warnte vor intelligenten automatischen Waffensystemen. Diese seien bereits im Einsatz. „Eine zunehmende Automatisierung ist auch auf den Schlachtfeldern wahrscheinlich und senkt die Schwelle des Einsatzes von Waffen“, sagt Nakamitsu. Doch derzeit gebe es keine Regularien für solche Systeme. „Die Staaten müssen sich auf einen gewissen Grad menschlicher Kontrolle verständigen“, fordert Nakamitsu. Im November soll es dazu ein Treffen geben. Amnesty International fordert ein Verbot von Kampfrobotern und hat in Genf zudem eine neue Initiative vorgestellt, mit der die Prinzipien der Menschenrechte für Künstliche Intelligenz weiterentwickelt werden sollen.

Neufassung von Asimovs Robotergesetzen

Auch Audi beschäftigt sich mit ethischen und moralischen Fragen von KI und das über das Standardproblem hinaus, wie autonome Autos in kritischen Situationen reagieren sollten. „Wir müssen sicherstellen, dass KI zum Wohle und Nutzen aller eingesetzt wird“, sagte Stadler, „Und nicht zum Schaden für uns“. So müsste man Vorschläge, wie ein bedingungsloses Grundeinkommen oder sogar eine Robotersteuer prüfen. Zudem schlug Stadler eine Neufassung der berühmten drei Robotergesetze des Science-Fiction-Autors Isaac Asimov vor. Denn die beruhten auf menschlichen Befehlen, die es aber bei selbstlernenden Systemen nicht mehr zwingend gebe. Regel eins: Der Umgang mit Künstlicher Intelligenz basiert auf menschlicher Intelligenz. Nummer zwei: Roboter und menschliche Wesen sollen sich nicht gegenseitig verletzen oder zulassen, dass ihnen Schaden zugefügt wird. Nummer drei: Roboter und Menschen sollen sich gegenseitig unterstützen, gemäß ihren spezifischen Fähigkeiten.

Der New Yorker Wissenschaftler Gary Marcus warnte hingegen vor einer anderen, viel alltäglicheren Entwicklung: „Unternehmen wie Alphabet patentieren gerade grundlegende Prinzipien der KI.“ Einige Patente seien lächerlich und gingen auf Forschungen zurück, die älter seien als Alphabet selbst. „KI sollte nicht nur für Unternehmenszwecke genutzt werden“, sagte Marcus, dessen letztes Unternehmen von Uber gekauft wurde. Damit mehr Wissenschaftler zusammenarbeiten, schlug er vor eine Einrichtung analog zum europäischen Forschungsinstitut CERN in der Schweiz zu gründen.

Die Reise nach Genf wurde unterstützt von Audi

- showPaywall:

- false

- isSubscriber:

- false

- isPaid:

- showPaywallPiano:

- false